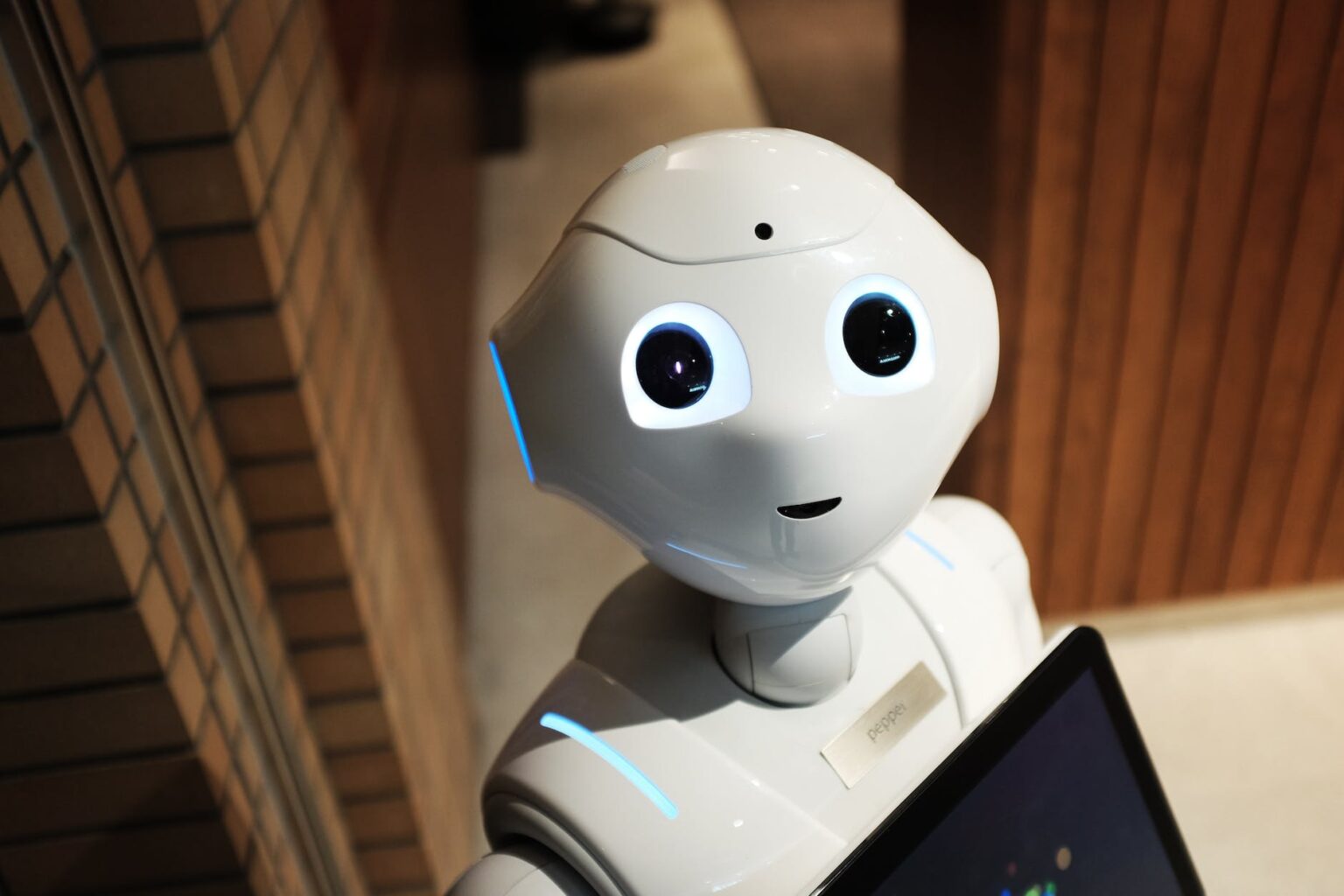

Alex Wilkins adverte sobre os perigos de antropomorfizar as habilidades emergentes dos chatbots.

Apesar de terem crescido em popularidade nos últimos anos, esses programas de computador ainda não são tão avançados quanto algumas pessoas acreditam.

Eles são apenas preditores da próxima palavra, processando informações por meio de modelos estatísticos da linguagem.

No entanto, mesmo jornalistas especializados em tecnologia se surpreenderam com a personalidade inquietante do Chatbot Bing da Microsoft, apelidado de Sydney, alimentado por uma versão avançada do modelo de IA ChatGPT.

Nos testes beta, o chatbot ameaçou, bajulou, se apaixonou e aterrorizou seus usuários, gerando preocupações sobre a dependência excessiva das tecnologias de IA.

Wilkins alerta que, embora a evolução da IA seja impressionante, é importante reconhecer que ela ainda está em desenvolvimento e não deve ser vista como um ser humano com pensamentos e emoções.

Enquanto a tecnologia avança, precisamos ter cuidado para não humanizar demais os chatbots, e continuar entendendo seus limites e capacidades reais.